Reflexiones sobre la generación de imágenes y video con IA

En un ecosistema donde la generación con IA se volvió commodity, la diferencia no está en producir más imágenes o videos, sino en construir consistencia sistemática: modelos bien elegidos, personalización inteligente y creatividad pensada para escalar con foco en negocio.

Andrés Kloster

31/12/2025

Hola, ¿cómo estás?

Este es el último newsletter del 2025 y quería cerrarlo hablando sobre algo en lo que estuve investigando y trabajando bastante este año: cómo generar imágenes y videos con inteligencia artificial.

Es un tema potente y con muchísimo potencial, pero sobre el que suele haber poca información clara y bien ordenada. Al mismo tiempo, el ritmo de lanzamientos y novedades es tan acelerado que se vuelve difícil separar lo que realmente aporta valor de lo que es solo ruido. El famoso rabbit hole.

Justamente por eso, decidí ordenar todo este aprendizaje en una sola pieza. Leerla te va a llevar aproximadamente 15 minutos y está dividida en dos partes. Primero, una parte más teórica para ordenar conceptos. Después, una parte más práctica con usos reales de cómo lo estamos aplicando en Eleven, para que puedas decidir si querés leer solo una o las dos.

Como siempre, al final, vas a encontrar las noticias más relevantes del mes sobre Growth, Adquisición, SEO y más. Empecemos.

Un poco de teoría para ordenar ideas

Modelos de generación de imágenes y videos

Cuando se habla de modelos de generación de imágenes con Inteligencia Artificial, se hace referencia a sistemas entrenados para crear imágenes nuevas a partir de una instrucción en texto, una imagen de referencia o una combinación de ambas. Estos modelos no buscan imágenes existentes ni las copian, sino que aprenden patrones visuales a gran escala: formas, estilos, colores, composición e iluminación. En la práctica, la mayoría de los modelos actuales funcionan con arquitecturas de difusión, donde el proceso parte desde ruido y, paso a paso, se va refinando hasta llegar a una imagen coherente que responde al prompt. Puede parecer complicado, pero para que te des una idea, es similar a este gif:

En los modelos de generación de video la lógica es similar, aunque el desafío es bastante mayor. Además de generar imágenes de calidad, el modelo tiene que mantener coherencia entre frames, respetar movimientos y sostener la identidad de objetos y personajes a lo largo del tiempo. Por eso, muchos modelos de video se apoyan en modelos de imagen preexistentes y les agregan una dimensión temporal. Esta diferencia es clave: generar una buena imagen ya es complejo, pero generar una secuencia consistente de imágenes lo es todavía más, tanto a nivel técnico como computacional.

Otro eje fundamental para entender este ecosistema es la diferencia entre modelos abiertos y modelos cerrados.

Los modelos abiertos, como Stable Diffusion o Flux, permiten acceder a los pesos y ejecutarlos en infraestructura propia. Esto habilita un nivel alto de control y personalización, especialmente útil cuando quiero adaptar el modelo a una marca o a un estilo visual específico. En el mundo del video open source todavía estamos más verdes, aunque empiezan a aparecer alternativas experimentales.

Del otro lado están los modelos cerrados, que hoy concentran gran parte de la innovación visible. En imágenes, algunos de los más relevantes a diciembre de 2025 son NanoBanana Pro de Gemini, Midjourney e Image 1.5 de OpenAI, entre otros. En video, modelos como VEO, Runway, Kling y Sora marcaron un salto importante en coherencia temporal, control del movimiento e incluso audio. Suelen ofrecer mejores resultados iniciales y una experiencia más simple, aunque con menos margen para intervenir en cómo el modelo aprende o representa un estilo propio.

Hasta acá, todo esto se puede resolver bastante bien solo con prompting. El problema aparece cuando empiezo a necesitar consistencia, repetición y control visual en el tiempo, especialmente si estoy trabajando para una marca, un producto o una campaña. Ahí es donde el prompting deja de ser suficiente y aparece la necesidad de ir un paso más allá. Para eso existen dos enfoques clave que voy a explicar a continuación: el fine tuning y las LoRAs.

Qué es el fine tuning

El fine tuning consiste en volver a entrenar un modelo existente con un dataset propio para que aprenda un concepto visual específico, como un producto, una persona, un estilo o una estética de marca. En lugar de partir de cero, se ajusta un modelo base que ya tiene una comprensión general del mundo visual.

Este proceso modifica los pesos del modelo, es decir, los parámetros internos que determinan cómo interpreta y genera imágenes. Dicho de forma simple, el modelo empieza a “ver” el mundo de una manera más cercana a lo que yo necesito. Por eso, el fine tuning es la forma más potente de personalización, pero también la más costosa y exigente.

Un ejemplo típico es el de un ecommerce que necesita generar imágenes de un mismo producto en distintos contextos, pero manteniendo siempre el mismo diseño, proporciones y detalles. En lugar de describir todo eso en cada prompt, entreno el modelo con imágenes reales del producto y logro que lo reproduzca de forma consistente. Lo mismo aplica para entrenar estilos fotográficos, identidades visuales de marca o personajes recurrentes.

Antes, hacer fine tuning implicaba trabajar con decenas de miles de imágenes. Hoy esa barrera bajó, pero sigue siendo un proceso intensivo en datos: incluso en escenarios bien acotados, se necesitan cientos y cientos de imágenes cuidadosamente curadas y coherentes entre sí. La diferencia es que ya no se entrena un modelo desde cero, sino que se ajusta uno que trae mucho conocimiento previo. Por eso, cuanto más claro y específico sea el objetivo, más eficiente puede ser el entrenamiento, aunque el volumen de datos siga siendo alto.

En la práctica, el costo puede escalar hasta varios miles de dólares, según el modelo, el dataset y la infraestructura. Los modelos más comunes para fine tuning hoy son Stable Diffusion, Flux y SDXL.

Qué es un LoRA

Una LoRA es una alternativa más liviana al fine tuning tradicional. En lugar de modificar todos los pesos del modelo, se entrenan capas adicionales mucho más pequeñas que aprenden un nuevo concepto y se acoplan al modelo base en tiempo de inferencia. El modelo original no se modifica: simplemente se le suma esta capa extra al momento de generar imágenes.

Esto hace que el proceso sea mucho más rápido, barato y fácil de iterar. Al requerir muchos menos datos, el volumen necesario baja de forma considerable. En la práctica, suelen utilizarse decenas de imágenes bien seleccionadas. Para conceptos simples o muy consistentes, incluso menos puede funcionar, aunque siempre existen trade-offs en estabilidad y repetibilidad.

En términos de costos, entrenar una LoRA suele ser muy accesible. En setups comunes, puede costar unos pocos dólares. Además, una misma base puede cargar múltiples LoRAs distintas, lo que vuelve al sistema mucho más modular y flexible.

Stable Diffusion, Flux y SDXL son hoy los modelos más utilizados para entrenar LoRAs y, en la práctica, se convirtieron en el estándar para personalización rápida en generación de imágenes.

El caso de Nano Banana

NanoBanana Pro es un modelo cerrado que marca un punto de inflexión en cómo pensamos la personalización de imágenes. A diferencia de los enfoques tradicionales, permite adaptar el modelo de forma extremadamente rápida utilizando datasets mínimos, incluso de apenas 8 imágenes, sin sacrificar calidad.

Antes de que apareciera NanoBanana Pro, en Eleven usábamos LoRAs prácticamente siempre que necesitábamos mantener consistencia visual entre imágenes: mismos personajes, mismos productos, misma estética. Era una solución efectiva, pero seguía implicando preparar datasets más grandes, entrenar y testear.

Con NanoBanana Pro, ese proceso se simplificó de manera drástica. Hoy, con solo unas pocas imágenes, podemos lograr consistencia no solo en personajes y objetos, sino también en la integración de texto dentro de la imagen, algo que históricamente fue un punto débil de muchos modelos. Esto lo vuelve especialmente potente para casos reales de marketing, donde conviven marca, mensaje y visual.

Además, el entrenamiento es extremadamente barato, del orden de pocos centavos de dólar, y los tiempos hasta obtener resultados utilizables son mínimos. En la práctica, esto baja de forma radical la barrera de entrada y nos permite iterar mucho más rápido, probar ideas y llevarlas a producción con una velocidad que antes no era posible.

A continuación, voy a recorrer algunos casos concretos de uso en Eleven.

Casos concretos de uso en Eleven

Generación de catálogos y contenido para E-commerce

Este es uno de los usos más claros que estamos trabajando hoy en Eleven para equipos de producto y marketing. Con Nano Banana Pro partimos de una o varias fotografías reales y generamos múltiples variaciones de contexto y ambientación sin perder la integridad del producto. En la práctica, esto nos permite mostrar una misma prenda o gadget en distintos escenarios (una playa, una oficina moderna o un entorno minimalista) manteniendo proporciones, texturas y detalles clave.

Además, el modelo nos permite hacer cambios de vestuario o de modelos sin alterar la identidad del producto. Esto reduce de forma significativa los costos de producción fotográfica: ya no es necesario organizar sesiones nuevas para cada campaña o temporada. Con una imagen de referencia bien tomada, podemos adaptar el entorno, el styling o el perfil del modelo según el objetivo de negocio.

Para los e‑commerce con los que trabajamos, esto nos abrió la puerta a experiencias visuales mucho más personalizadas. Ahora podemos mostrar un mismo producto en un contexto invernal o veraniego según la ubicación del usuario, aumentando la relevancia visual y, en muchos casos, la tasa de conversión.

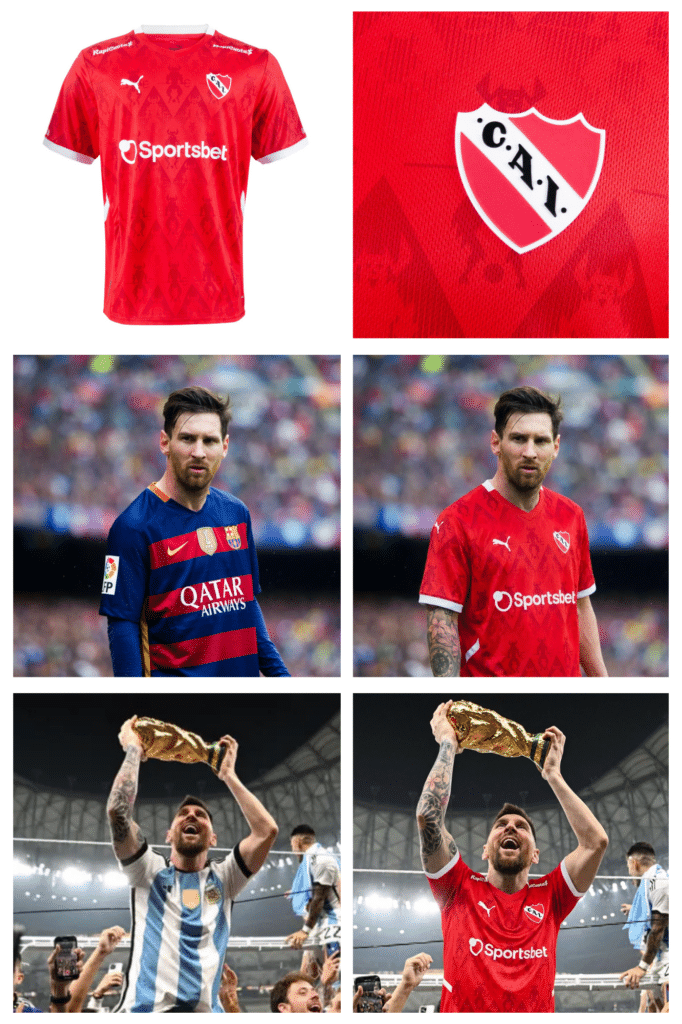

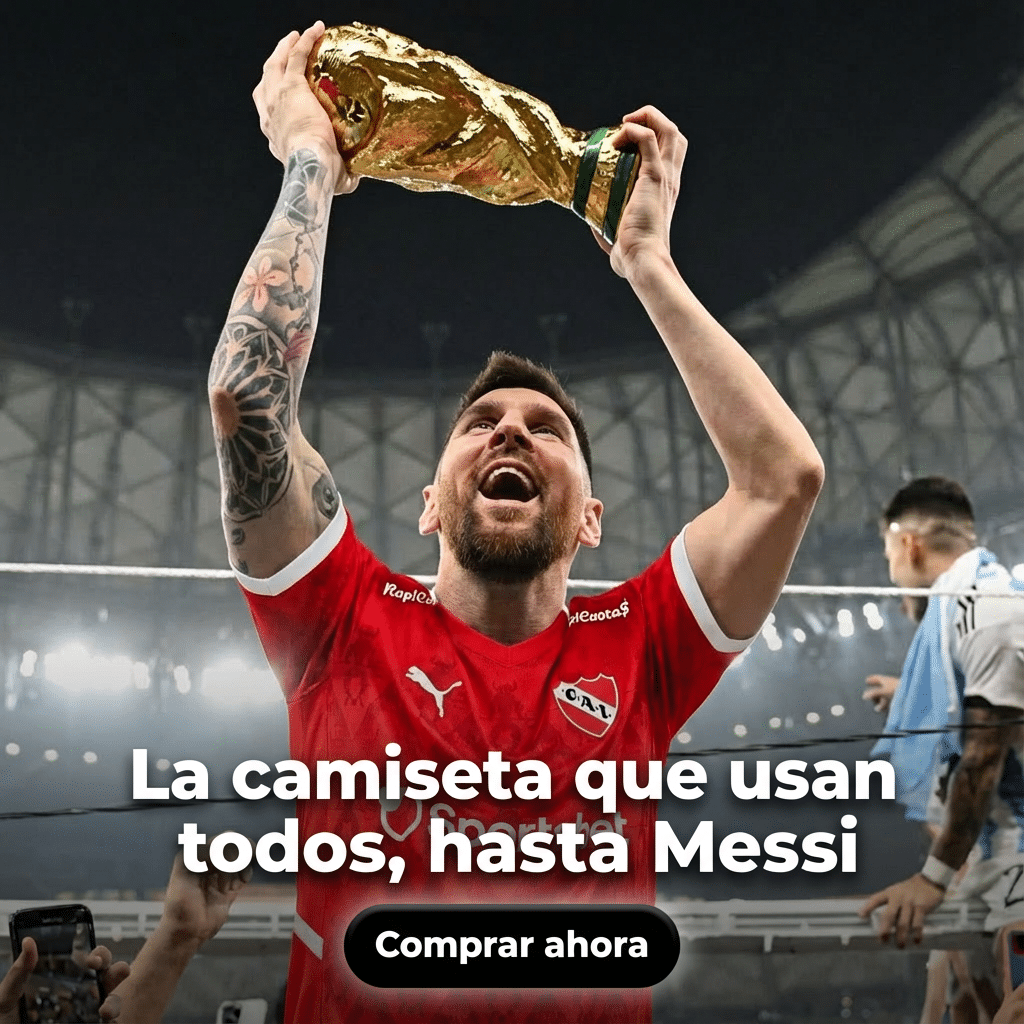

Por una cuestión de confidencialidad no voy a dar ejemplos reales de empresas con las que trabajamos en Eleven, pero supongamos que queremos hacer contenido para el ecommerce del mejor equipo del mundo: Independiente. Usando solo las 6 imágenes que hay sobre la camiseta en su sitio web podemos ponérselo a cualquier modelo, incluso a Messi.

Ustedes pensarán: lo hizo con photoshop. Y no, es NanoBanana Pro, con dos imágenes y un prompt simple en inglés.

Creación de piezas estáticas para pauta en Meta y Display con texto legible

Durante mucho tiempo, el texto fue uno de los grandes límites de la generación de imágenes con IA. A fines de 2025, Nano Banana Pro resolvió este problema de forma sólida, permitiendo integrar copies, slogans y llamados a la acción directamente en la imagen, con tipografías limpias y en múltiples idiomas.

Para equipos de Growth o Performance Marketing, esto habilita la generación rápida de grandes volúmenes de piezas publicitarias. Es posible crear decenas o cientos de variaciones en minutos, cada una con mensajes distintos para audiencias o hipótesis específicas.

En campañas de Meta o Google Display, el valor está en la velocidad de experimentación. Integrando un workflow en N8N se pueden hacer cientos de imágenes en pocos minutos para testear combinaciones de fondos, estilos visuales y posicionamiento del texto para identificar qué variante maximiza el CTR.

Transformación de imágenes estáticas en micro‑animaciones para Reels y TikTok

Este es otro uso que venimos trabajando activamente con clientes en Eleven, especialmente en marcas que necesitan escalar contenido para redes sin multiplicar costos de producción. El consumo de video corto domina la distribución de contenido, y Nano Banana Pro nos facilita el paso de lo estático a lo dinámico de forma muy eficiente.

En la práctica, con clientes partimos muchas veces de una sola imagen aprobada de producto o campaña y generamos micro‑animaciones coherentes de pocos segundos que respetan la iluminación, la física y la composición original. Una foto puede transformarse en un Reel con movimiento sutil: vapor que se desplaza, luces que parpadean o pequeños gestos del modelo. Este tipo de loops funciona especialmente bien en el scroll infinito de TikTok e Instagram, donde el movimiento es clave para captar atención.

Este flujo de trabajo nos permite reutilizar bibliotecas completas de imágenes existentes de nuestros clientes, ahorrar horas de edición manual y convertir activos estáticos en piezas dinámicas listas para social, sin necesidad de volver a producir desde cero.

Generación de avatares sintéticos para videos UGC

Este es uno de los usos que más estamos explorando con clientes en Eleven desde 2025. La capacidad de Nano Banana Pro para mantener consistencia de personaje nos permite crear avatares virtuales hiperrealistas que funcionan como embajadores de marca permanentes.

Para los equipos de marketing con los que trabajamos, esto significa no depender de un creador de contenido distinto para cada reseña o campaña. Diseñamos junto al cliente un avatar con una estética definida (edad, estilo, tono) alineada a su público objetivo, y lo utilizamos de forma recurrente en campañas de TikTok o Reels, garantizando una identidad visual consistente.

Redactamos un guión y generamos las imágenes base del avatar en distintos ángulos y expresiones, manteniendo fidelidad de rostro y vestimenta. Luego, con lip‑sync y clonación de voz, el avatar cobra vida para realizar unboxings, testimonios o piezas explicativas.

La principal ventaja táctica que vemos en clientes es la escalabilidad para pruebas A/B. Podemos generar decenas de versiones de un mismo video UGC en muy poco tiempo, cambiando hooks, tono o idioma. Incluso trabajamos localización humana: el mismo avatar puede hablar español rioplatense para Argentina y portugués para Brasil, sin rehacer la producción.

Finalmente, este enfoque reduce riesgos de marca y costos operativos. Al ser un activo digital propiedad del cliente, se evitan problemas de derechos de imagen y se puede sostener una producción continua de contenido orgánico que alimenta el algoritmo y acompaña la performance de manera constante.

No te pierdas los episodios de Eleven Talks

Si te interesa seguir profundizando en estos temas, en Eleven tenemos un podcast llamado Eleven Talks. Son charlas de SEO y Growth entre expertos del equipo, donde compartimos experiencias reales y lo que aprendemos todos los días trabajando con distintas marcas. Te dejo la playlist completa en YouTube para que puedas explorarlo.

Suscribite al newsletter

Únete a cientos de profesionales que ya están recibiendo las novedades más importantes de SEO cada mes. Suscríbete gratis y no te pierdas lo que está marcando la agenda en la industria.